內核數量比全球第一E級超算多1.6倍!世界最大芯片打造最強AI超級計算機!

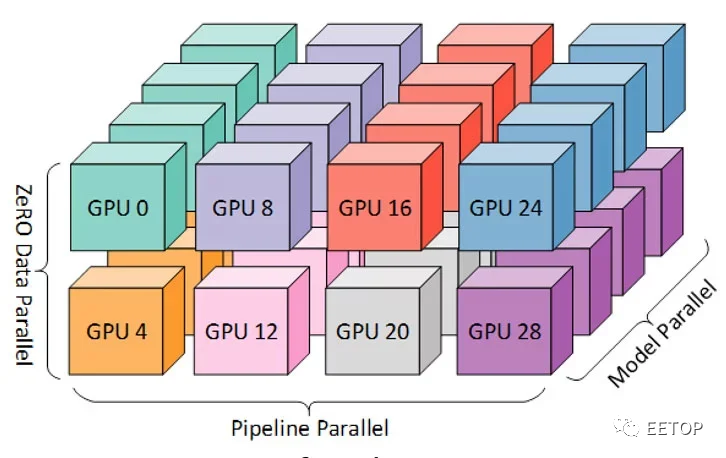

2022-11-18 12:45:10 EETOP該公司正試圖消除通用計算平臺的常見挑戰,例如在分布式GPI集群上實施培訓所需的額外開銷。有些分布式系統的3D配置對工程師來說很復雜的。

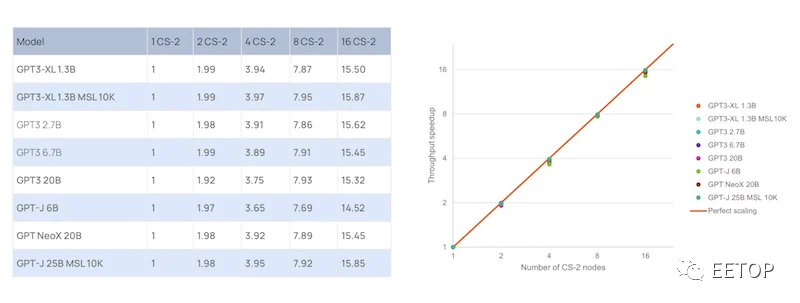

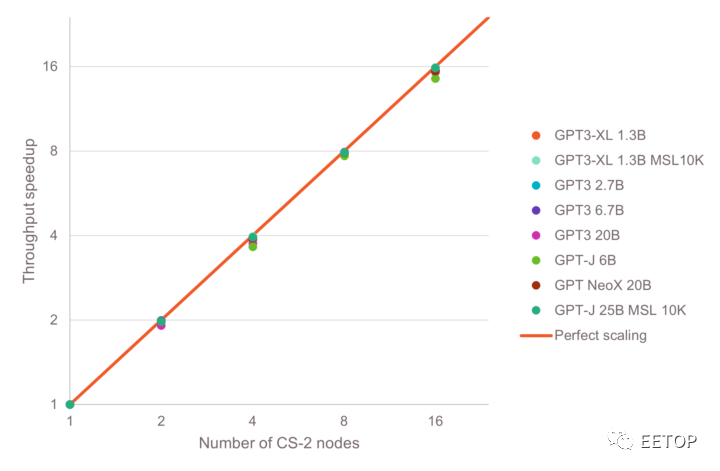

Cerebras 最近發布了其Andromeda超級計算機,包括一個 AI 應用特定的硬件架構,可以在多個 GPT 語言模型上提供線性擴展訓練;簡而言之,訓練時間隨著所涉及的計算核心數量的增加而線性減少。這與計算單元與訓練時間之間具有亞線性關系的通用 GPU 集群不同。

Cerebras 聲稱,由于內存和帶寬限制,類似的工作不可能在 2,000 個NVIDIA A100 GPU 的集群上進行。

Andromeda 建立在 Cerebras 的 CS-2 系統之上,包括總共1350萬個 AI 優化計算核心和18,178 個第三代 AMD EPYC 處理器。

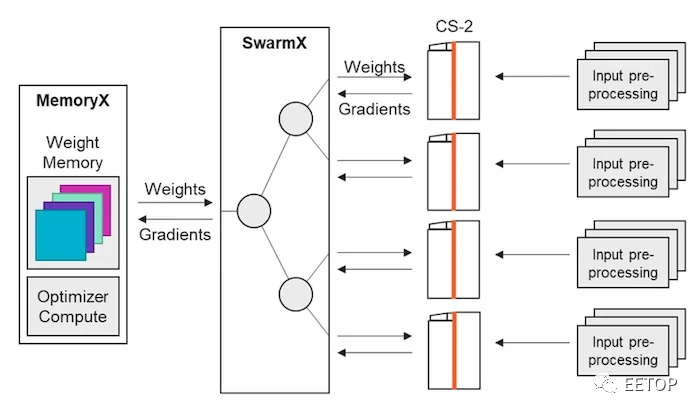

該超級計算機還采用晶圓級集群和權重流,由 Cerebras 的 MemoryX 和 SwarmX 技術提供支持。Andromeda 產生 1 exaflop 的 AI 計算和 120 petaflops 的密集計算,具有 16 位半精度。

Andromeda 擁有 16 個 CS-2 系統,每個系統都配備了 Cerebras 的Wafer-Scale Engine 2 (WSE-2) 處理器——一個 46,225 mm 2處理器和 2.6萬億個 7nm 晶體管。據報道,WSE-2 是“地球上最大的處理器”。配套的軟件平臺集成了 PyTorch 和TensorFlow,開箱即用。

以下是 CS-2 的其他一些規格:

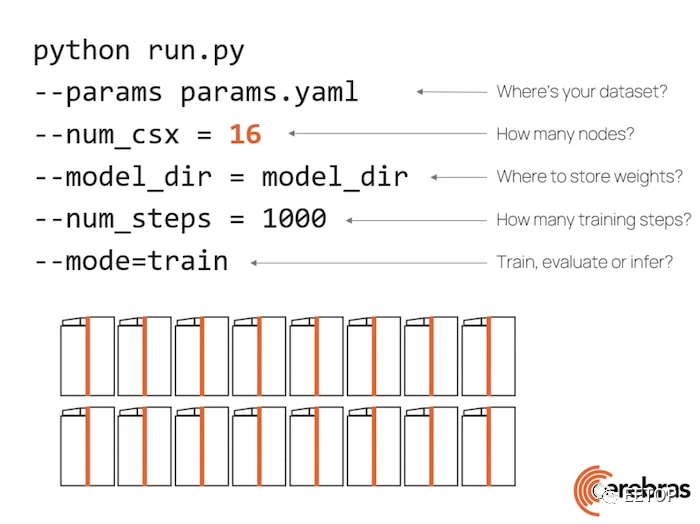

晶圓級集群通過在單個處理器中安裝包括計算組件和參數組件的整個神經網絡來充分利用 WSE-2 的大小。晶圓級集群還利用了數據并行性。分配簇數就像設置參數一樣簡單明了。

這消除了在分布式系統上計劃和配置訓練模型的需要,這可能是復雜、緩慢且耗電的。此外,由于 AI 計算是在單個設備上完成的,因此訓練速度更快。

權重流

Cerebras 的MemoryX 和 StreamX 技術支持權重流。MemoryX 管理片外模型權重的存儲,包括將權重流式傳輸回處理器模型、計算更新的權重以及計時交付。MemoryX 可以支持 2000 億到 120 萬億個參數,并聲稱速度與片上一樣快。

SwarmX 是存在于 MemoryX 和 CS-2 系統之間的另一種支持技術。它將權重分配給 CS-2 系統并將生成的梯度提供回 MemoryX。這兩種技術共同實現了訓練過程中的重量流。

Cerebras 已為多家研發和學術機構提供了 Andromeda 的各種應用訪問權限。

阿貢國家實驗室使用 GPT3-XL 模型和整個 COVID-19 基因組,利用 Andromeda 開發了基因轉換器。與此同時,JasperAI 正在使用Andromeda 訓練模型,這些模型將用于為廣告、營銷和書籍等書面材料撰寫文案。

Andromeda 托管在加利福尼亞州的 Colovore 數據中心,Cerebras現在可以訪問更多潛在客戶。