速度快10倍,Groq芯片一夜爆紅!英偉達(dá)要被趕下神壇?

2024-02-21 11:46:28 EETOP

Groq名字與馬斯克的大模型Grok讀音類似,成立于2016年,定位為一家人工智能解決方案公司。

Groq爆火主要是因?yàn)槠涮幚硭俣确浅?臁?jù)媒體報(bào)道,該公司的芯片推理速度較英偉達(dá)GPU提高10倍,成本只有其1/10。

運(yùn)行的大模型生成速度接近每秒500 tokens,碾壓ChatGPT-3.5大約40 tokens/秒的速度。

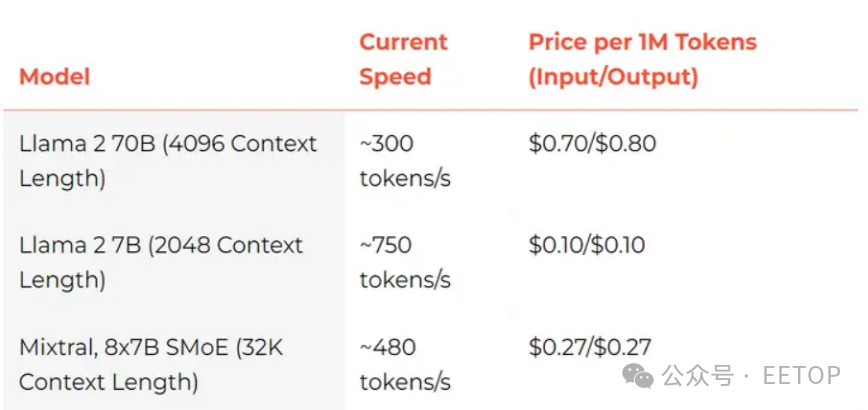

極限情況下,Groq的Llama2 7B甚至能實(shí)現(xiàn)每秒750 tokens,為GPT-3.5的18倍。

在Groq的創(chuàng)始團(tuán)隊(duì)中,有8人來自谷歌早期TPU核心設(shè)計(jì)團(tuán)隊(duì),但Groq并未選擇TPU、GPU、CPU等路線,而是自研了語言處理單元(LPU)。

Groq官網(wǎng)顯示,在 Groq LPU?推理引擎上運(yùn)行的Meta AI的Llama 2 70B的性能優(yōu)于所有其他基于云的推理提供商,吞吐量提高了18倍。

能否取代英偉達(dá)?

不過,速度并不是AI發(fā)展的唯一決定性因素。在Groq爆火的同時(shí),也有一些質(zhì)疑聲音。

首先,Groq似乎只是看起來便宜。Groq的一張LPU卡僅有230MB的內(nèi)存,售價(jià)為2萬多美元。

有網(wǎng)友分析,英偉達(dá)H100的成本效益應(yīng)為Groq的11倍。

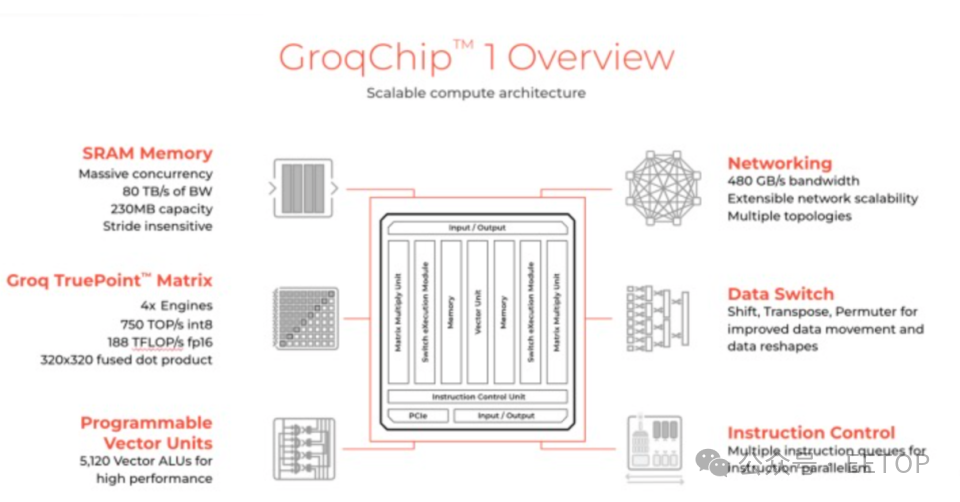

更為關(guān)鍵的是,Groq LPU完全不配備高帶寬存儲(chǔ)器(HBM),而是僅配備了一小塊的超高速靜態(tài)隨機(jī)存取存儲(chǔ)器(SRAM),這種SRAM的速度比HBM3快20倍。

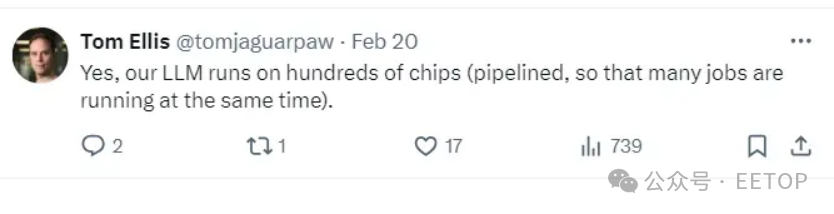

這也意味著,與英偉達(dá)的H200相比,在運(yùn)行單個(gè)AI模型時(shí)需要配置更多的Groq LPU。

另據(jù)Groq員工透露,Groq的LLM在數(shù)百個(gè)芯片上運(yùn)行。

對(duì)此,騰訊科技的芯片專家姚金鑫認(rèn)為,Groq的芯片目前并不能取代英偉達(dá)。

以下是姚金鑫轉(zhuǎn)寫的文章:

有關(guān)Groq芯片跑大模型超越英偉達(dá)芯片的文章火爆了朋友圈,這是個(gè)非常好的案例來科普,甚至反思一些現(xiàn)象。

首先,從技術(shù)上解釋還原一下這件事情的本來面目,然后基于這件事情,表達(dá)幾個(gè)對(duì)背后引人深思現(xiàn)象的看法。

一、速度快,但成本奇高

技術(shù)上解釋:

幾個(gè)關(guān)鍵信息點(diǎn):SRAM的容量是230MB,帶寬80TB/s,F(xiàn)P16的算力是188TFLOPs。

按照當(dāng)前對(duì)大模型的推理部署,7B的模型大約需要14G以上的內(nèi)存容量,那么為了部署一個(gè)7B的模型,大約需要70片左右的芯片,根據(jù)透露的信息,一顆芯片對(duì)應(yīng)一張計(jì)算卡,按照4U服務(wù)器配置8張計(jì)算卡來計(jì)算,就需要9臺(tái)4U服務(wù)器(幾乎占了一個(gè)標(biāo)準(zhǔn)機(jī)柜了),總共72顆計(jì)算芯片,在這種情況下,算力(在FP16下)也達(dá)到了驚人的188T * 72 = 13.5P,如果按照INT8來算就是54P。54P的算力來推理7B的大模型,用大炮打蚊子來形容一點(diǎn)也不為過。

如果是英偉達(dá),朋友圈文章對(duì)標(biāo)的是H100,其采用的是80G的HBM,這個(gè)容量可以部署5個(gè)7B的大模型實(shí)例;我們?cè)賮砜此懔Γ∈杌螅琀100在FP16下的算力將近2P,在INT8上也將近4P。

那么就可以做個(gè)對(duì)比,如果從同等算力來看,如果都是用INT8來推理,采用Groq的方案需要9臺(tái)包含72片的服務(wù)器集群,而如果是H100,達(dá)到同等算力大約需要2臺(tái)8卡服務(wù)器,此時(shí)的INT8算力已經(jīng)到64P,可以同時(shí)部署的7B大模型數(shù)量達(dá)到80多個(gè)。原文中提到,Groq對(duì)Llama2-7B的Token生成速度是750 Tokens/s,如果對(duì)標(biāo)的是H100服務(wù)器,那這2臺(tái)總共16顆的H100芯片,并發(fā)吞吐就高到不知道哪里去了。如果從成本的角度,9臺(tái)的Groq服務(wù)器,也是遠(yuǎn)遠(yuǎn)貴過2臺(tái)H100的服務(wù)器(即使此刻價(jià)格已經(jīng)高到離譜),

Groq:2萬美金72=144萬美金,服務(wù)器2萬美金9=18萬美金,純的BOM成本160萬美金以上(全部都是按照最低方式來計(jì)算)。

H100: 30萬美金2 = 60萬美金(國外),300萬人民幣2=600萬人民幣(國內(nèi)實(shí)際市場價(jià))

這還沒有算機(jī)架相關(guān)費(fèi)用,和消耗的電費(fèi)(9臺(tái)4U服務(wù)器幾乎占用整個(gè)標(biāo)準(zhǔn)機(jī)柜)。

如果是70B的模型,同樣是INT8,要用到至少600張卡,將近80臺(tái)服務(wù)器,成本會(huì)更高。

實(shí)際上,部署推理性價(jià)比最高的,恰恰是4090這種神卡。

二、速度,在這里成了Groq的雙刃劍。

可是為什么Groq和自媒體都有意無意地引導(dǎo)人們已經(jīng)超越英偉達(dá)了呢?并且大多數(shù)人都還相信了呢?

這首先是因?yàn)橛ミ_(dá)在本次AI浪潮中的絕對(duì)領(lǐng)先地位,使得全球都翹首以盼挑戰(zhàn)者。每次吸引眼球的文章,總會(huì)在最初被人相信,除了這個(gè)原因之外,還是因?yàn)樵谧鰧?duì)比時(shí)的“套路”,故意忽略其他因素,用單一維度來做比較。這就好比那句名言“拋開事實(shí)不談,難道你就沒有一點(diǎn)錯(cuò)的地方嗎?”

拋開場景來談對(duì)比,其實(shí)是不合適的。對(duì)于Groq這種架構(gòu)來講,也有其盡顯長處的應(yīng)用場景,畢竟這么高的帶寬,對(duì)許多需要頻繁數(shù)據(jù)搬運(yùn)的場景來說,那就是再好不過了。

總結(jié)起來,Groq的架構(gòu)建立在小內(nèi)存,大算力上,因此有限的被處理的內(nèi)容對(duì)應(yīng)著極高的算力,導(dǎo)致其速度非常快。

現(xiàn)在把句話反過來,Groq極高的速度是建立在很有限的單卡吞吐能力上的。要保證和 H100同樣吞吐量,你就需要更多的卡。速度,在這里成了Groq的雙刃劍。

關(guān)鍵詞: Groq

EETOP 官方微信

創(chuàng)芯大講堂 在線教育

半導(dǎo)體創(chuàng)芯網(wǎng) 快訊

相關(guān)文章