NVIDIA的最新技術使人工智能的聲音更具表現力和真實感

2021-09-01 09:14:11 cnBeta.COM

為了改進其人工智能語音合成,NVIDIA的文本-語音研究團隊開發了一個名為RAD-TTS的模型,這是NAB廣播大會上開發最逼真化身的比賽的獲勝作品。該系統允許個人用自己的聲音訓練文字轉語音模型,包括節奏、音調、音色等等。

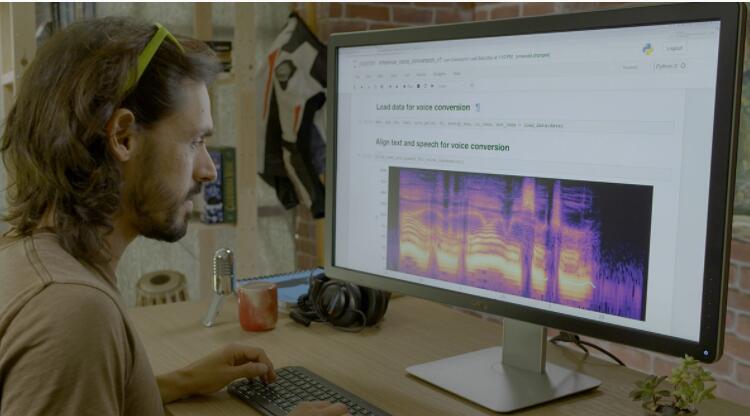

RAD-TTS的另一個特點是語音轉換,它可以讓用戶用另一個人的聲音來傳遞一個說話者的話語。該界面可以對合成的聲音的音調、持續時間和能量進行精細的、幀級的控制。

利用這項技術,NVIDIA的研究人員為自己的《我是人工智能》系列視頻創造了更多聽起來像對話的語音解說,使用的是合成的聲音而不是人的聲音。其目的是讓解說詞與視頻的語氣和風格相匹配,這是迄今為止許多人工智能解說視頻中沒有做到的。結果仍然有點像機器人,但比我聽過的任何人工智能解說都好。

"有了這個界面,我們的視頻制作人可以錄下自己閱讀視頻腳本的過程,然后用人工智能模型將他的語音轉換為女解說員的聲音。"NVIDIA公司寫道:"利用這一基線旁白,制作人可以像配音演員一樣指揮人工智能--調整合成的語音以強調特定的詞語,并修改旁白的節奏以更好地表達視頻的基調。"

NVIDIA公司正在分發這項研究的一部分--當然是為了在NVIDIAGPU上有效運行而進行的優化--通過用于GPU加速的對話式人工智能的NVIDIA NeMo Python工具包(可在該公司的容器和其他軟件的NGC中心獲得),向任何想要嘗試的人開放源代碼。其中幾個模型是在NVIDIA DGX系統上用數萬小時的音頻數據訓練出來的。開發人員可以針對他們的使用情況對任何模型進行微調,利用NVIDIA Tensor Core GPU上的混合精度計算加快訓練速度。

免責聲明:本文由作者原創。文章內容系作者個人觀點,轉載目的在于傳遞更多信息,并不代表EETOP贊同其觀點和對其真實性負責。如涉及作品內容、版權和其它問題,請及時聯系我們,我們將在第一時間刪除!