能耗降低100倍!美國開發光子AI芯片——直接利用光做卷積!

2025-09-24 09:01:29 EETOP佛羅里達大學領導的一個研究團隊,與加州大學洛杉磯分校和喬治華盛頓大學合作,開發了一種原型光子AI芯片,該芯片利用光進行卷積操作,與電子等效芯片相比,能耗降低了多達兩個數量級。這一創新的核心是一種完全集成的基于菲涅耳透鏡的架構,在芯片上執行二維空間卷積,且全部在模擬光學域中進行。

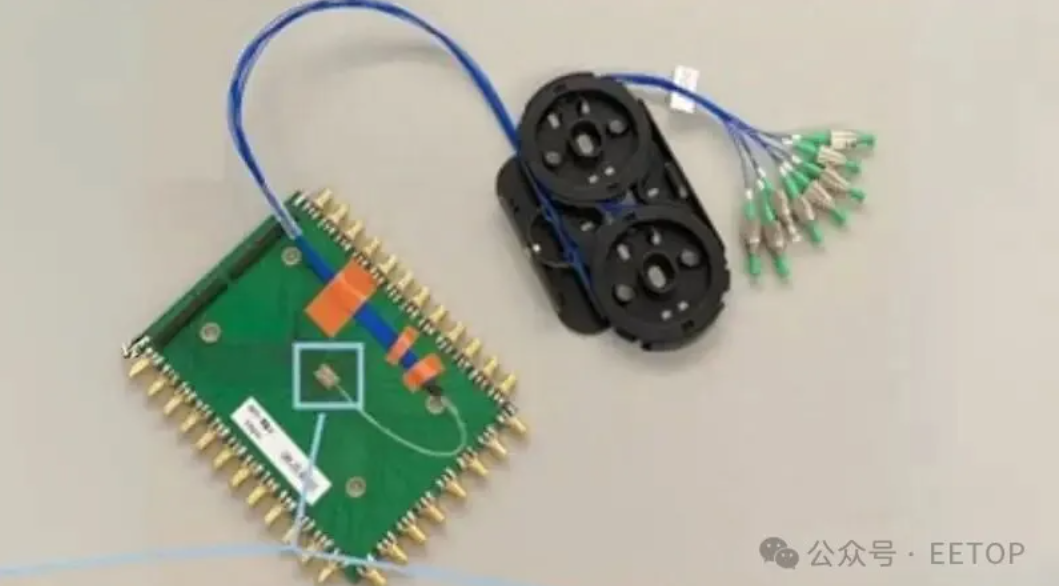

封裝的光子聯合變換相關器,包括硅光子芯片、定制印刷電路板和八通道光纖陣列。

該芯片是同類產品中的首款,通過被動衍射光學器件執行空間卷積,并單片制造在硅光子基板上。該原型為深度學習中最耗費資源的操作之一——卷積神經網絡(CNN)中的乘累加(MAC)操作——實現了近零能耗計算。

測試結果和性能指標

研究人員使用一個訓練用于分類MNIST數據集手寫數字的CNN對芯片進行了測試,這是機器學習中的標準基準。該光子卷積模塊被集成到網絡的第一層,對輸入圖像應用學習到的內核。網絡的其余部分采用數字實現,模擬混合推理流程。

研究報告顯示,該芯片達到了98.1%的分類準確率,與純電子推理流程幾乎沒有區別。但在能效方面,差異巨大。與傳統的數字卷積引擎(基于CPU、GPU或FPGA)相比,該光子芯片將每次推理的能耗降低了100倍,預計操作能耗低至皮焦耳級。

重要的是,該架構與波長無關,并支持波分復用(WDM)。通過為不同數據通道使用不同波長,可以在同一物理結構中并行運行多個卷積操作,從而在不增加占地面積或熱負載的情況下擴展計算吞吐量。

對邊緣AI的影響

這種光學CNN加速器解決了功率密度問題,這是部署邊緣AI的最大瓶頸之一。隨著CNN的深度和復雜性增加,卷積操作主導了計算預算。在緊湊的邊緣設備(如傳感器、無人機、可穿戴設備或植入式設備)中運行AI推理,不僅需要高效性,還需要熱靜默和占地最小化。

所制造的SiPh芯片的光學顯微鏡圖像。

通過這種基于透鏡的方法,計算是被動的、無風扇的且本質上并行的。它避開了電子加速器常見的內存帶寬、數據移動瓶頸和熱節流等問題。由于光的模擬特性允許連續值內核應用,因此也避免了量化或剪枝的妥協。

此外,由于該芯片采用標準光刻技術制造,因此可以與現有硅光子平臺單片集成,或與CMOS后端配對。這使其比以往的自由空間光學或光纖耦合設計更實用,后者需要笨重的設置,不適合商業集成。

一種新的混合計算模型

該芯片并非完整的神經處理器,它僅處理卷積步驟。但通過將最耗能的前端計算卸載到光學領域,并將決策邏輯或全連接層留給傳統硅電路,它定義了一種新的混合計算模型。未來的系統可能在同一基板上共同集成用于CNN的光子加速器、用于邏輯的數字控制器以及用于數據存儲的內存陣列。

隨著AI硬件競賽的加速,此類創新指向了一個未來,在那里計算不再局限于電子和晶體管,而是擴展到光子、干涉以及光的根本屬性。

該原型由美國海軍研究辦公室資助開發,并作為同行評議的硅兼容被動芯片上卷積演示,在《先進光子學》雜志上發表。

原文:

https://www.allaboutcircuits.com/news/optical-chip-beats-counterparts-in-ai-power-efficiency-100-fold